L4级自动驾驶中的环境感知传感器有哪些?他们的功能有何区别呢?

自动驾驶是指让汽车自己拥有环境感知、路径规划并且自主实现车辆控制的技术,也就是用电子技术控制汽车进行的仿人驾驶或是自动驾驶。美国汽车工程师协会(SAE)根据系统对于车辆操控任务的把控程度,将自动驾驶技术分为L0-L5,系统在L1~L3级主要起辅助功能;当到达L4级,车辆驾驶将全部交给系统,而L4、L5的区别在于特定场景和全场景应用。

自动驾驶技术分层

自动驾驶系统可以分为感知层、决策层、执行层,L4级自动驾驶系统实现在特定区域内对车辆操作的完全接管,系统需要实现:对周围障碍物的感知、车辆定位以及路径规划(2W1H),实现这些功能需要构建感知层、决策层、执行层这三个层面的技术架构,这三个技术层级分别代表着L4自动驾驶系统的眼和耳、大脑以及手脚。

自动驾驶技术架构

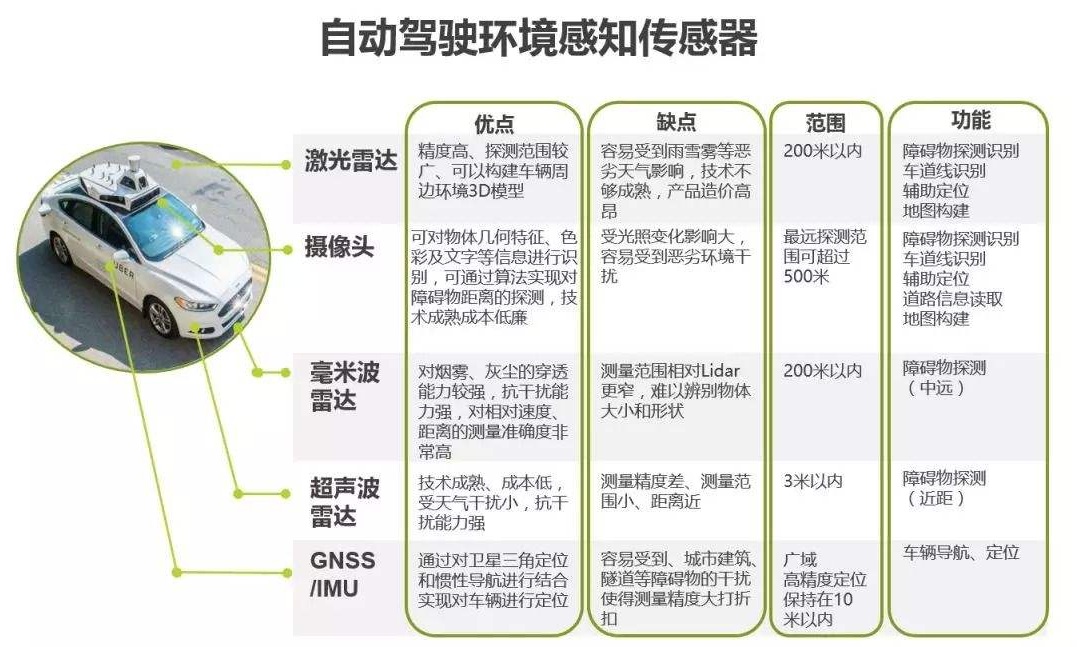

感知层依赖大量传感器的数据,分为车辆运动、环境感知两大类:车辆运动传感器:速度和角度传感器提供车辆线控系统的相关横行和纵向信息。惯性导航+全球定位系统=组合导航,提供全姿态信息参数和高精度定位信息。环境感知传感器:负责环境感知的传感器类似于人的视觉和听觉,如果没有环境感知传感器的支撑,将无法实现自动驾驶功能。主要依靠激光雷达、摄像头、毫米波雷达的数据融合提供给计算单元进行算法处理。

自动驾驶环境感知传感器

摄像头:主要用于车道线、交通标示牌、红绿灯以及车辆、行人检测,有检测信息全面、价格便宜的特定,但会受到雨雪天气和光照的影响。由镜头、镜头模组、滤光片、CMOS/CCD、ISP、数据传输部分组成。光线经过光学镜头和滤光片后聚焦到传感器上,通过CMOS或CCD集成电路将光信号转换成电信号,再经过图像处理器(ISP)转换成标准的RAW,RGB或YUV等格式的数字图像信号,通过数据传输接口传到计算机端。

激光雷达:激光雷达使用的技术是光飞时间法(Time of Flight)根据光线遇到障碍的折返时间计算距离。为了覆盖一定角度范围需要进行角度扫描,从而出现了各种扫描原理。主要分为:同轴旋转、棱镜旋转、MEMS扫描、相位式、闪烁式。激光雷达不光用于感知也应用于高精度地图的测绘和定位是公认L3级以上自动驾驶必不可少的传感器。

毫米波雷达:主要用于交通车辆的检测,检测速度快、准确,不易受到天气影响,对车道线交通标志等无法检测。毫米波雷达由芯片、天线、算法共同组成,基本原理是发射一束电磁波,观察回波与入射波的差异来计算距离、速度等。成像精度的衡量指标为距离探测精度、角分辨率、速度差分辨率。毫米波频率越高,带宽越宽,成像约精细,主要分为77GHz和24GHz两种类型 。

组合导航:GNSS板卡通过天线接收所有可见GPS卫星和RTK的信号后,进行解译和计算得到自身的空间位置。当车辆通过遂道或行驶在高耸的楼群间的街道时,这种信号盲区由于信号受遮挡而不能实施导航的风险。就需要融合INS的信息,INS具有全天候、完全自主、不受外界干扰、可以提供全导航参数(位置、速度、姿态)等优点,组合之后能达到比两个独立运行的最好性能还要好的定位测姿性能。

随着产业链成熟和产量提升硬件成本有望实现大幅下降,目前大体上实现L4自动驾驶的硬件设备一般包含:6~12台摄像头、3~12台毫米波雷达、5台以内的激光雷达以及1~2台GNSS/IMU和1~2台计算平台(不同方案会选择不同侧重的传感器)。当前一整套L4级自动驾驶系统硬件成本还比较昂贵,整体基本在50万元左右甚至更高,而未来随着资本、研发的不断投入,自动驾驶产品逐渐落地、配套产业链逐渐成熟,预计整套系统硬件成本会在1~2年左右降至10~20万元,并最终有望控制在10万元以内。