7年AI产品人眼里的ChatGPT

本文来自微信公众号:棋言说棋语(ID:gh_32f8964f3804),作者:超超,题图来自:《梅根》

上一次AI这么火,还是阿尔法狗的时候,六七年过去了,这次AI的热度更高了,不止反映在无休止的新闻讨论上,热度还进一步推高到股市炒作上。

做为7年的AI从业者,正好经历这两波AI话题,聊聊自己的想法。

我们说的AI,除了偏技术和2B的机器学习等领域,对于消费者可感知的,一般指的视觉+语音。

视觉比较成熟了,但是语音一直还是智障状态。

语音交互的听-想-说环节,听(ASR语音识别)、说(TTS语音合成) 都在几年前做到了图灵测试的程度,也就是超过人类的准确率,但“想”的环节(NLP)一直没得到突破.......

从体验上来说,耳朵再灵光、嘴巴再会巴巴、没有脑子一样歇菜,这是过去语音智障的原因。

而今天,ChatGPT已基本走到了图灵测试的门口,以它为代表的NLP突破,基本是能宣告人工智障的时代要过去了,真人工智能要来了。

不过,这次AI创新,的确值得更高的热度,原因并不在于它如此惊艳的对话表现,而是因为这次ChatGPT(狗屁通)的创新,意义大于上次的阿尔法狗(特定任务的AI);

插个八卦,“狗屁通”的名字,来自网友,我觉得很形象:一是,啥狗屁问题,ChatGPT都能给你讲通、侃侃而谈;二是,它给的回答滴水不漏,富有语言逻辑,但都是车轱辘话、废话,没有事实逻辑,又可以说是狗屁不通。

我们都知道,阿尔法狗是围棋AI,当时AI学术和产业界,普遍认为未来会出现越来越多的这种“特定任务的智能”,通用人工智能则比较不现实。

而这次GPT模型,最大的突破就是打了专家的脸,它具有通用性,并不需要为特定任务做大量单独工作,一个模型解决所有需求:

基于GPT,既能改出来ChatGPT用于对话,还能改出来Dall-E2模型用于图像生成,更能改出来Codex模型用于帮助程序写代码,接下来还有更多可能性。

ChatGPT的底层模型GPT,打开了通用人工智能的可能性,可以说是“狗屁通”对阿尔法狗的完胜。

一、它是什么?

说回来主角,ChatGPT,它是什么?

如果你问它,它会回答你,“我是语言模型”,比较抽象。但是如果你进一步问它,它可能会给出“语言”“对话”之类的关键词。

图/ChatGPT

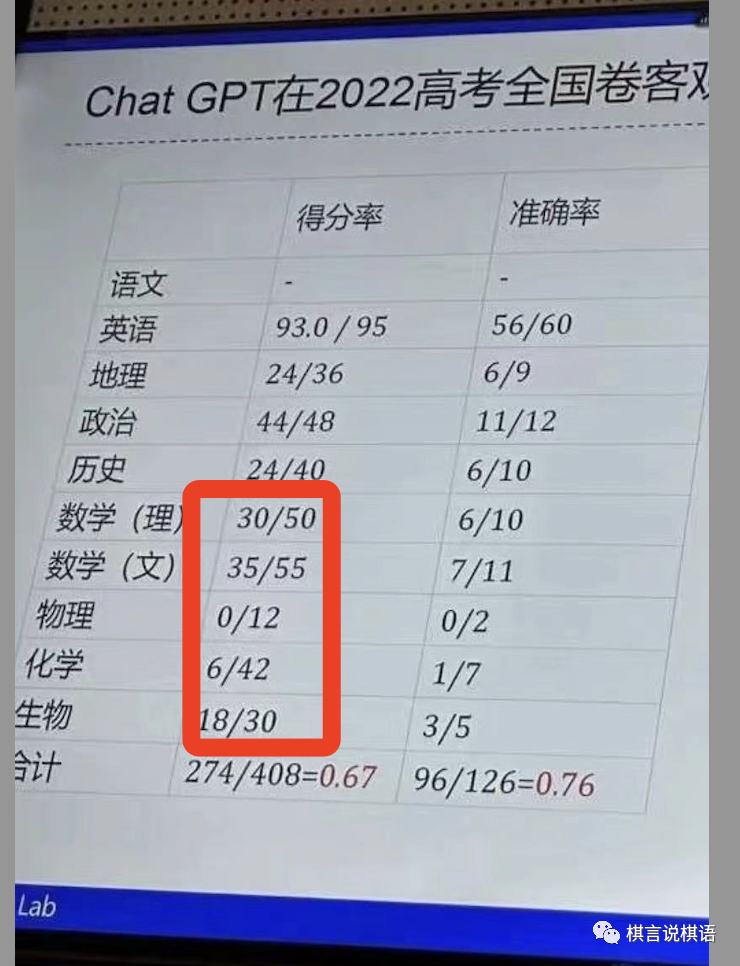

更形象地把它作为一个考生来做分类的话,下面这个图,可以明显看出ChatGPT是典型的文科生,数理化明显较差。

这也符合它是文科生的原因,毕竟作为“通读”整个互联网数据的模型,就像是一个书读了很多的学生,这种学生的特点是博闻强记,知识量大、记忆力强,一般是文科生居多。

图/复旦大学自然语言处理实验室(Fudan NLP Lab)

可以猜测,ChatGPT的高考分数大概在500分左右,其实并不高,但是要知道,中文数据尤其是这种试卷类数据,ChatGPT应该没有收录太多。而且如果要下切一个模型,搞一个考试GPT,那么基本可以完虐考生,就像当年阿尔法狗完虐围棋高手一样。

这也是“狗屁通”对阿尔法狗的完胜原因,因为一个是高维生物,可以降维打击,低维生物却无法突破自己的天花板。

可以总结出来,ChatGPT的本质是:

“语言”模型(文科生)

大“语言”模型(博士文科生)

二、ChatGPT是怎么炼成博士的?

以一个学生(GPT)的高考之旅,为例子:

前两年,有个学生叫GPT,有点底子,全能100项,啥都会点,但是在垃圾学校里,没啥前途,忧虑起了自己的未来。???

1. 转学期

经过一番思索,GPT转学到了新学校——OpenAI。

转校之后,教导主任东风不败挖掘了它的底子,觉得它博而不专、没法适应高考。

于是委派了扫地僧老师,对它进行微调,修剪羽毛、打磨棱角(微调 fine-tuning),让它发挥出语数英的专业考试能力。(注意:仿生)

算法小科普:底子再好,不对路也考不赢人,模型必须微调才能用。

2.?入学期?

经过调教后的狗屁通,洗掉了一身的二流子气,看起来像是个标准的学生了,扫地僧老师一上来啥也没教,就发了之前自己做过的几份试卷(但不多)。(few-shot prompt)

问题和答案都有(有监督训练),让它自己看,什么样的才是好的答案。

算法小科普:算法学习,可以不用有名师,但必须有名题,有了标准试题,犹如拿到了武功秘籍。

3. 自学期?

看完扫地僧老师的试卷,懵懵懂懂,GPT自己又去看完了图书馆里所有的书和试卷。(自监督学习)

它好书烂书都看,自己也不知道对错。(文本中学习In-context learing)

学了45TB的书(数据),形成了1750亿的知识点(参数)。(大模型)?

变成了“小博士鸠摩智”,只觉得有一股强大的气流在脑子里乱窜。

好学生,还是要靠自觉啊,自己监督自己!(注意:仿生)?

经过自学之后,这时候基础模型出来了,只有60分,思路很多但也乱。

算法小科普:自学期(预训练),学得越多越好,即Pre-trained,自监督的预训练算法。以往的做法是给大量有监督的数据,这次只需要给出少量示例few-shot, 让模型从文本中直接进行学习(In-context learning),这是有别于以前的做法,经济又有效。

4. 教学期

学完之后,GPT有点膨胀,开始做全国高考卷了,扫地僧老师给它批改,发现它经过囫囵吞枣、虽然满腹经纶、但是胡说八道,简直错漏百出......

扫地僧老师很头疼,不过也只能一点点纠正,对的表扬、错的批评,教育方式很传统,有小红花也有打手板(奖惩模型)。

经过老师的教学,不断循环重复,GPT成绩更好了,小红花贴了一墙壁,打遍校内无敌手。

实际上,教算法,跟教小孩一样,上奖惩,训得服服帖帖的。(注意:仿生)???????

有了老师调教,这时候它有70分,知道哪个答案更好了。

算法小科普:奖惩模型Reward modle,这里打分指的是,模型对一个问题给出的多个答案,哪个答案更对,老师会进行排序,再给到奖励模型进行打分的训练,这样学习出来的答案更接近标准答案。

5. 高考期?

教得差不多了,GPT很有信心了,教导主任也对它充满希望,马上要高考了,特地给它改了个名字,“就叫你ChatGPT了”。

ChatGPT开始高调参加各种联考(面向用户的内测网页),校外的监考老师(用户)通过赞和踩,给了它很多反馈。

ChatGPT也学到了更多高分技巧(怎么答题监考老师才会给高分、才会喜欢)。

RLHF模型,Reinforcement Learning by Human Feedback,通过人类反馈来学习,仿生中的仿生,是取悦。(注意:仿生)?

最终,ChatGPT高考成绩接近了满分,高考分数史上最高,打破了记录(这里指图灵测试)。

(注:以上为故事化讲解,简化调整部分步骤,方便理解,不要抬杠。)

6. 总结

总结起来,ChatGPT最大的不同或者说特征:

自学为主,不需要太多监督,In-context learing是非常重要的概念。

先自学后教学,教学以奖惩模型为主,去提高答案排序的质量。

通过反馈再次学习,取悦用户。

更大量的参数,大力出奇迹。

可以看到,仿生思路似乎是AI的正确路径,思考题:

思考题1:AD的路线之争,特斯拉为什么坚持纯视觉方案?会不会是正确的?

思考题2:人形机器人、3D超写实,是不是正确方向?

三、我们能做出ChatGPT吗?

个人观点:不能。

训练成本:因为参数量大,每次训练都需要大量烧钱,据网上说450万美刀/次,王慧文的5000万刀,只够训10次.......另一说,买显卡就要先拿个1亿美刀.......应该说创业机会不大,但是大厂机会还是有的。(反例:数百亿的O2O投入。)

运营成本:据说每次成本0.01美元,按照现在1亿月活,假如月平均10次,那就是每个月1000万刀。(实际数字可能要更大。)

耐心成本:从头开始,我们可能还需要至少3年,长期看不到结果的投入,这在现在没有问题,对于没有指明方向的长期投入,我们会欠缺耐心,但是热度那么高,这个问题并不存在。

不过我们可能会缺少另一种形式的“耐心”,套用某AI从业者的说法:我们的CEO可能在面对首席科学家的“1000亿参数模型3年100亿资金投入”的说法,可能砍上几刀,变成“1500亿参数模型,给你1年时间50亿资金”。(就是个举例。)

这种不尊重科学的放卫星做法,在国内蔚然成风,热度当前,更是不讲实际、大好快上(反例:耐心问题,阿里云坚持亏损投入10年。)?

刚好前两天看到一个脉脉动态,如下图,这种甚至连技术工作都是由销售领导的做法,可能就更没戏了。

人才瓶颈:缺的可能不是最顶尖人才,而且顶尖人才里有想法的人。

?Meta的杨立昆是AI三驾马车之一,最顶尖的存在,照样没搞出来ChatGPT这种突破性体验的产品,还在各种酸......它不止一次翻车,有空下次再讲一下它。

而对于我们来说,原创算法的顶尖人才缺乏(中国没有出过哪怕一款主流的AI底层算法),有想法的可能更缺乏。

做梦环境:成功背后的辛苦,通用人工智能在6年前(也就是阿尔法狗那年),基本被认为不可能,而OpenAI更是在8年前就启动了,那个时候的很多核心工程师,不止经受3倍薪资的诱惑,而且要经受漫漫没希望的长路里......

这种梦想和做梦的环境,可能在任何国家都是很稀缺的特质和土壤。(这点照样有反例:阿里云王坚和马云的搭档,大家可以了解一下。)

创新和包容文化:有个故事,OpenAI的带头人“奥特曼”也是个不守规矩的人,在给YC投资孵化器打工的时候,它靠着“内幕消息”,YC投啥,它自己在外面的基金就投啥,结果赚了十倍的钱。

它的老板格雷厄姆(写《黑客与画家》的那个人),反倒特别欣赏它的这种出格,这个做法要是在国内可能早就被按死,甚至进局子了。

整体来说,上面每一项可能都有反例,但是所有加起来,可能就无解了。

因此,个人观点,如果说ChatGPT是iPhone,我们能做的就是小米、OV,基本不可能超越。

但是基于国情+抓风口热情+搞应用能力,虽然我们做不了最牛的底层创新,但我们大概率还会和互联网时代一样,创造出最牛的应用。

各行业的垂类第一名,很多可能还都是国内企业......因为,在任何时候,都是场景大于技术。

基于开源或自研的ChatGPT,我们可能还是会有很多全球 NO.1(纯举例,别当真):

搞股票全世界(未来)最牛ChatGPT:同花顺- i问财

搞保险全世界(未来)最牛ChatGPT:平安- AskBob

搞穿搭全世界(未来)最牛ChatGPT:阿里- 淘宝XX

四、ChatGPT会带来什么影响?

个人观点:

1. “算法参数定律”可能成为下个时代最核心的底层规律。

摩尔定律作为TMT时代的底层定律,驱动了计算机、手机、穿戴、智能家居等设备的数字化,而数字化之后 ,接下来让其智能化的定律是什么,尤其是在摩尔定律摸到了天花板的时候,大家都知道答案是AI。

而AI的底层规律是什么,我们都说算法、算力、数据是AI三要素,但这无法概括和总结规律,那应该是什么呢,个人大胆猜测:算法参数定律。

因为,算法参数,作为三要素沉淀的结果,先进算法、不断提升的算力以及海量和优质的垂类数据,最终驱动了参数的提升,参数量大,基本也能反映智能的程度。

So,how?有一份数据说明,AI算力需求每3-4个月就翻一番,而算法参数在算力和数据的共同驱动下,未来可能会稳定在每十几个月翻一番。

实际上现在还在快速拉升的阶段,基本几个月就能翻一番,没有摸到天花板,连边际效用递减的那条曲线都还没摸到,而参数大量增长,由此产生的“智能”增长,驱动TMT和各行各业的智能化,带来新一波的浪潮。

2. 投资商机:接下来全球一批AI大模型创业者,谁能烧成全球第二不知道,但是应该能烧出一个新的英伟达市值。(注:该分析不构成投资建议)

据说,训练一个千亿级参数量的模型,需要1000张显卡,且是超强算力的那种显卡(A100),这还不算从0到千亿参数的中间过程。加上上面的描述,AI算力需求,每3-4个月就翻一番,比摩尔定律快多了。

3. 情感机器人,《HER》的时代可能也要一起到来了。

前两天看到了一个段子,说有个程序猿男生嫌自己嘴笨,弄了个在线机器人,让它和有好感的对象聊,结果这个女生和AI机器人聊得热火朝天、一聊就是一整夜......

有没有电影《HER》的即视感了?是的,也许这样的时代也要一起到来了。当然,这个人可能不是ChatGPT,ChatGPT是个小博士,大家都知道,博士是不容易有对象的......它也志不在此。

机会可能是Replika的,不过ChatGPT如果要切出来一个小模型,专门做情感模型,也是足够吊打的。

4. 语音行业迎来改变,传统聊天机器人也许死掉或者转型,而以前因为智障而不吃香的语音产品,可能卷土重来,比如智能音箱。

5. 号称已有布局的公司(不点名了),基本是骗子,不是忽悠就是坏。

可能是首席科学家忽悠老板CEO,偷换概念,说我们也有大语言模型之类的.......但其实大语言模型一直就有,比如Bert,但从来没有做到如此突破性的程度,ChatGPT ≠ 大语言模型,或者说大语言模型不足以概括它,这是偷换概念。

当然,也可能CEO没有被骗,只是蹭热度哄抬股价,那就是坏了。二者合一的可能就更普遍了,下瞒上、上瞒韭菜。

6. ChatGPT+Midjourney,一个真正的数智人,可能会产生更大的影响力。

有人说ChatGPT是2G,就是文本、是QQ,抖音是5G,有画面和互动,但如果ChatGPT+Midjourney结合在一起了,有智能有画面,真正的数智人就出现了,这可能是更大的风暴。

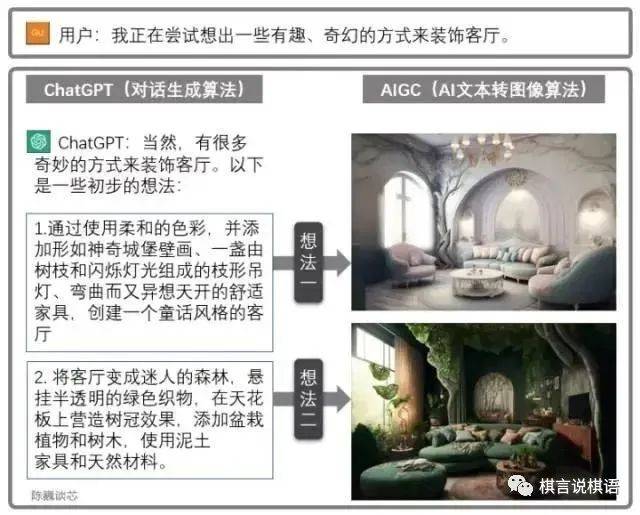

具体来说,智能文本+智能图片的复合产品,就是数智人,会解决一些特定领域的痛点。比如:链家在线AI数智人,图文生成指导你怎么选房......淘宝某店铺家居店AI数智人,图文生成指导你沙发摆哪里

BTW,今天的这些AI创新,这也许都在为明天的元宇宙铺路,所以短期内不看好元宇宙,不代表长期不看好。

图片来自“陈巍谈芯”

7. ChatGPT,短期内可能会触发大量AI生意。

一个最强的AI诞生了,站在它的肩膀上,每个垂类行业可能存在大量的赚钱机会(小的那种),比如:

网页摘要GPT插件。(据说ChatGPT for Google卖了一些钱,这个也许也有市场)

都市情感小说GPT。(据说在小城市很有市场,讲家长里短的,如果能做成个数智人,有个AI主播绘声绘色地讲,可能就更好了)

创作者/UP主优化工具GPT。(ChatGPT基于点击量高的标题和文案数据,来训练学习生成好的标题,Dall-E2基于点击量高的图片来训练学习生成头图)

故事机/学习机GPT。(据说有家长用ChatGPT给每个单词编一个故事,让孩子学习,孩子能很快记住)

除了ChatGPT,还有个Midjourney也很值得关注,强烈建议大家去学一下,有网友根据关键词(prompt keyword)做出三体角色照片,比如,可以做为导演的选角参考?

AI克隆主播GPT。(给不愿意露脸或者不上相的主播,或者没法全天候在线的小明星,甚至有一套成熟的工具,可以无研发成本快速投入使用,几十美元买几个软件,做一个小工作坊)

五、三个FAQ

1. 大模型为什么牛/火?

这个问题,或者说这次GPT大语言模型的特征:

自学为主,不需要太多监督,In-context learing是非常重要的概念。这可以节省大量成本和时间,而且理论上网络所有数据都可以学。

以往的深度学习等方法一直比较依赖标注数据,而现实世界中某个具体任务的数据量有限而且标注也有难度,训练数据上不去,深度(层数)也就不上去,效果就出不来了。

此外,算法上的进步也是很大的因素,GPT模型对知识的吸收度更好。

先自学后教学,教学以奖惩模型为主,去提高答案排序的质量。

这其实并不是什么大的创新,在搜索引擎、推荐系统等产品中就有大量应用了,根据用户点击来做动态提权的排序,好多年前就有了。只是ta放在整个ChatGPT的设计中,就很妙了,先让模型自学会答题,再调教答案,再次学习什么是好的答案,这似乎的确是最经济最有效的方法。

通过反馈再次学习,取悦用户。

RLHF的方法,RL(强化学习)是前几年很流行的算法,但是通过人类反馈做强化学习,虽然不是首次应用,但还是在ChatGPT身上取得了首次重大胜利。

对人类的答案倾向性的研究,让AI从用户中做二次学习,就像不止是研究考题,还研究批卷老师,不高分都难了,所以还是那句话,仿生中的仿生,是取悦。但说句题外话,这可能打开了一个潘多拉盒子,可以预测,以后的AI可能会说谎了。

更大量的参数,大力出奇迹。

大模型有更好的体验,可能是因为更大量的参数,模型越大、性能越强,出来的产品甚至比特定任务的专家模型效果更好,而且理论上它还有可以一直无限量扩大,这是开头提到的“算法参数定律”的主要根据之一。

2. 什么是参数?越多越好?

有一些参数是对语言学习的特征抽象,比如句法结构,为什么是两驾飞机,而不是两份飞机,传统上称之为语言学;? ? ?。

还有一些参数是对事实的抽象,比如现在的总统是拜登,传统上称之为知识图谱。

从这里可以看出,参数肯定越多越好,因为参数约等于知识。 ? ?

从体验上来说,知道的多(广度上)可能够了,但知道不够精(深度上)。?

这个时候,可能需要堆的是某些垂直领域的数据库,在该领域内把参数做大,这时候考验的是对垂直数据库的争夺和清洗能力。但,参数越多不代表体验越好:吸收度也很重要,尤其是在后期的时候。

虽然ChatGPT到了千亿参数的级别,举个例子:前几天New Bing内测,有人问“詹姆斯打了几场常规赛”,正确答案是1410场,但New Bing的回答是1577场(这是全部的比赛场次的数量)。

也就是说,它区分不了常规赛和总场次的区别,这就是吸收度不够的例子,数据都有,但吸收不够。从这个角度,不要被国内说什么万亿级参数的模型唬到了,质量上很可能一般般。

从准确率等各项指标的提升曲线上看,参数的作用,到后期的时候,不断地堆数据、提升参数量的时候,可能会发现,准确率已经不上升了,或者说是进入边际效用递减的过程了。

这个时候堆数据、堆参数的价值就没那么大了,这可能也是OpenAI当时辟谣要推出万亿级参数模型的原因,说下一代,比这一代,在参数上可能提升不了太多。

大家可能会说,这两个反例,是不是对你前面“算法参数定律”的打脸,不不不,就和这个时代的“摩尔定律”一样,晶体管数量越多,手机体验真的有变得更好吗?

它不是唯一变量,但不影响它成为这个时代的底层定律。

3. ChatGPT的瓶颈或者说下一步是啥?

主要的问题,就是大家都在说的:1. 没实时知识;2.有些内容/事实瞎编;3. 生成的答案不稳定。但这些问题都不是不可解的。

1已经通过和微软Bing的结合解决了,2和3可以参考下图,实际上这些问题一直在优化,相信下一代能优化得更好。

最核心的瓶颈可能是,它没有想法,或者高级点的词——意识!

它现在还是个没有原创能力的知识博士,做不了真正有想法、有创造力的作品。

比如它设计不出真正有独创性的界面交互设计、它提不出真正有影响的独创语音设计.......当然这有好有坏,有了意识很可怕,但有了意识才是真的人,才能做出真正有质量的东西。

本文来自微信公众号:棋言说棋语(ID:gh_32f8964f3804),作者:超超

中国最懂ChatGPT的那一小撮人,在这了。2月28日下午,虎嗅邀请领先企业、机构、学术专家共同探讨通用大模型的前景和落地现状。点击链接或扫码,立即上车!