机器人如何使用传感器进行定位与导航?

定位和导航

近70年来,工业机器人已经能够进行大量的运动。即使是第一台工业机器人(详见本系列第一篇博客),其中央 "臂 "也有9个自由度,其 "手 "也有滚动和偏航。有各种方法来跟踪这些运动部件的相对位置。

最简单的可能是 "死计算",即相对于一个已知的起始点测量位置。然后根据驱动力施加的时间长短来计算运动量。这种方法依赖于在所有条件下相关部件的衔接是相同的。使用传感器可以进一步改善这种情况。

通过计算电机运行时的转数,由转数计算出的移动距离是绝对的。将这些测量结果结合起来,对控制机器人手臂的每个电机部分进行测量,就可以将其定位在三维空间中。使机器人能够了解自己在工作空间中的位置。这种位置传感所使用的传感器类型包括:

电位计

光学编码器

霍尔效应传感器

这种位置传感方法在没有 "意外 "发生的环境中效果不错。它不能提供预期在更开放环境中工作的机器人所需的空间意识水平。即使对于静态机器人来说,感知和理解周围环境的能力也会带来能力的提升。

MEMS运动传感器提供最重要的洞察力

影响这一领域最重要的创新之一是基于MEMS的运动传感器的发展。MEMS是一种以集成电路的规模提供机电功能的技术。其结果是,传感器每边的测量尺寸仅为毫米。但是,它仍然可以检测到9个自由度的运动--为使用死角计算进行位置传感带来了新的洞察力。MEMS传感器帮助控制系统精确测量其每个运动部件的角度位置。

Murata公司的SCL3300倾角传感器是这种技术应用于机器人技术的一个很好的例子。它使用电容式3D MEMS技术测量3个轴的运动。Analog Devices公司的iSensor MEMS陀螺仪也可以测量基于加速度的角变化率。它提供基于相对位移角的输出。控制系统可以利用这一信息来监控运动速度。

机器人正在使用光来进行三维观察

现在机器人技术中使用的其他传感器技术包括飞行时间(ToF)。一种根据光在两点之间传播所需的时间,精确测量发射器和接收器之间距离的技术。这可能听起来不太可能,但自动对焦相机使用了ToF,所以它是一项成熟的技术。一些制造商为需要精确距离测量的应用提供ToF传感器。除了将其用于近距离检测外,ToF还可以提供非常详细的表面3D浮雕图。这意味着机器人也可以用它来检测甚至识别物体。

对于希望在机器人应用中使用ToF的工程师来说,Basler Blaze 101视频模块是一个很好的开始。这款ToF相机在数米距离内几乎达到毫米级精度。它提供实时的预处理图像流,包括3D点和2D强度。ToF方法可检测反射光,因此它只能 "看到 "与该光直接一致的物体。这提供了足够的数据来创建 "点云",这是用来描述ToF技术生成的3D图像的术语。

然后,这些点云可以使用AI技术进一步处理,以识别形状和它们的距离。对于需要在操作物体之前识别物体的机器人来说,即使是在传送带上移动的物体,也有很大的好处。

机器人如何使用激光雷达进行导航?

另一项正在寻找进入机器人技术,特别是设计为移动的机器人的技术是LiDAR,即光探测和测距。由于它使用光,该技术在许多方面与ToF相似。ToF可以被认为是LiDAR的一个子集。

它一般通过测量反射光源的振幅或相位的变化来工作。受控(通常是脉冲)光源,在扫描激光雷达中转向,或者如果系统不提供3D图像,则固定。

反射光源的振幅或相位的偏移量给出了扫描对象的范围。现在的激光雷达系统体积小、精度高,足以用于机器人技术。英特尔的RealSense LiDAR相机L515是一款固态LiDAR深度相机,它使用基于MEMS的镜子,可以扫描其视野。

移动机器人面临的下一个重大挑战

现在,这些技术被用于机器人技术,以解决开发者和制造商接下来的一个重大挑战。如何让机器人在陌生的环境中移动?这个问题并不是机器人领域独有的,在人工和虚拟现实领域工作的计算机科学家和工程师们也在思考这个问题。

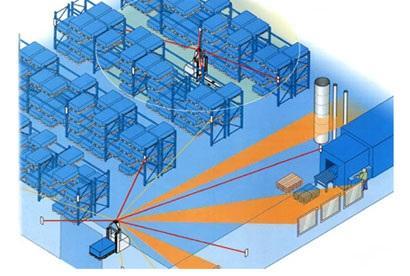

一种正在发展的技术是同步定位和映射,或SLAM。这项技术涉及扫描一个区域,并对该视野中的物体进行测绘,同时对扫描设备在该空间中移动时的位置进行补偿。自主车辆将使用SLAM来导航,机器人也在使用同样的技术来提高自主性。

开发机器人技术解决方案的半导体制造商也提供软件开发套件。它们支持将位置和导航传感器等硬件与软件算法集成,以实现SLAM。